گوگل مدل جدید FunctionGemma را معرفی کرد

شرکت گوگل، در ادامه انتشار مدلهای نوآورانه هوش مصنوعی، اخیراً FunctionGemma را معرفی کرده است. این مدل تخصصی ۲۷۰ میلیون پارامتری، با هدف حل یکی از مهمترین چالشهای توسعه اپلیکیشن مدرن، یعنی قابلیت اطمینان در لبه، طراحی شده است.

به گزارش سرویس هوشمصنوعی جهانی مگک، FunctionGemma قادر است دستورات زبان طبیعی کاربران را بدون نیاز به اتصال ابری، به کدهای ساختاریافتهای که برنامهها و دستگاهها میتوانند واقعاً اجرا کنند، ترجمه کند و یک تغییر استراتژیک مهم برای Google DeepMind و تیم توسعهدهندگان هوش مصنوعی گوگل را نشان میدهد.

در حالی که صنعت هوش مصنوعی همچنان به دنبال مقیاس تریلیون پارامتری در فضای ابری است، گوگل با FunctionGemma بر روی “مدلهای زبان کوچک” (SLM) شرطبندی کرده است. این مدلها به صورت محلی بر روی تلفنها، مرورگرها و دستگاههای اینترنت اشیا (IoT) اجرا میشوند. FunctionGemma برای مهندسان هوش مصنوعی و سازندگان سازمانی، یک اصل معماری جدید را به عنوان یک “روتر” با اولویت حریم خصوصی و قابلیت مدیریت منطق پیچیده با تأخیر ناچیز، ارائه میدهد. این مدل هماکنون برای دانلود در Hugging Face و Kaggle در دسترس است و کاربران میتوانند با دانلود اپلیکیشن Google AI Edge Gallery از Google Play Store، عملکرد آن را در عمل مشاهده کنند.

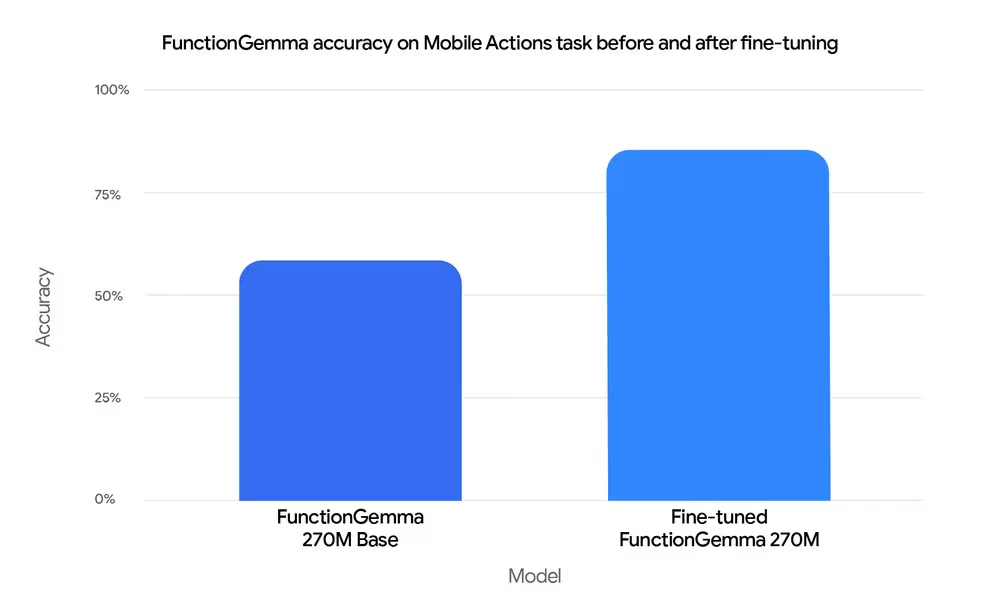

FunctionGemma، در هسته خود، “شکاف اجرایی” را در هوش مصنوعی مولد برطرف میکند. مدلهای زبان بزرگ استاندارد (LLMها) در مکالمه عالی عمل میکنند، اما اغلب برای راهاندازی قابل اعتماد اقدامات نرمافزاری، به ویژه روی دستگاههای با منابع محدود، با مشکل مواجه میشوند. طبق ارزیابی داخلی گوگل، یک مدل کوچک عمومی تنها به دقت پایه ۵۸٪ برای وظایف فراخوانی تابع دست مییابد. اما FunctionGemma، پس از تنظیم دقیق برای این هدف خاص، دقت خود را به ۸۵٪ رساند که عملکردی مشابه مدلهای بسیار بزرگتر از خود را به نمایش میگذارد. این قابلیت، مدل را برای مدیریت آرگومانهای پیچیده، فراتر از سوئیچهای ساده روشن/خاموش، مانند شناسایی مختصات شبکه خاص برای هدایت مکانیک بازی، توانمند میسازد.

این انتشار تنها شامل وزنهای مدل نمیشود؛ گوگل یک “دستورالعمل” کامل را نیز برای توسعهدهندگان ارائه کرده است که شامل:

- مدل یک ترانسفورمر ۲۷۰ میلیون پارامتری است که روی ۶ تریلیون توکن آموزش دیده است.

- مجموعه داده “Mobile Actions” برای کمک به توسعهدهندگان در آموزش عوامل خود.

- سازگاری با Hugging Face Transformers، Keras، Unsloth و کتابخانههای NVIDIA NeMo.

عمر سانسویرو، مسئول تجربه توسعهدهنده در Hugging Face، تطبیقپذیری این مدل را در X (توییتر سابق) برجسته کرد و گفت که مدل “برای وظایف شما تخصصی طراحی شده است” و میتواند “در تلفن، مرورگر یا سایر دستگاههای شما” اجرا شود. این رویکرد محلیمحور، سه مزیت متمایز را ارائه میدهد: حریم خصوصی (دادههای شخصی هرگز دستگاه را ترک نمیکنند)، تأخیر پایین (اقدامات فوراً و بدون انتظار برای رفت و برگشت سرور اتفاق میافتند) و کاهش هزینه (توسعهدهندگان هزینههای API به ازای هر توکن را برای تعاملات ساده نمیپردازند).

FunctionGemma، برای توسعهدهندگان سازمانی و معماران سیستم، حرکتی را از سیستمهای هوش مصنوعی یکپارچه به سمت سیستمهای ترکیبی پیشنهاد میکند. سازندگان میتوانند FunctionGemma را به عنوان یک “کنترلر ترافیک” هوشمند در لبه مستقر کنند. این مدل در یک محیط تولیدی، به عنوان اولین خط دفاعی عمل کرده و دستورات رایج و با فرکانس بالا (مانند ناوببری یا کنترل رسانه) را روی دستگاه کاربر، فوراً، مدیریت میکند. اگر یک درخواست به استدلال عمیقتر یا دانش جهانی نیاز داشته باشد، مدل آن را به یک مدل ابری بزرگتر هدایت میکند. این رویکرد هیبریدی، هزینههای استنتاج ابری و تأخیر را به طرز چشمگیری کاهش میدهد.

به نقل از ونچربیت، برای شرکتها، قابلیت اطمینان قطعی، به ویژه در برنامههای حیاتی مانند بانکداری یا تقویم، بر هرج و مرج خلاقانه اولویت دارد؛ جهش به دقت ۸۵٪ FunctionGemma، این تخصص را تأیید میکند. علاوه بر این، FunctionGemma، با اجرای کارآمد بر روی دستگاه (سازگار با NVIDIA Jetson، CPUهای موبایل و Transformers.js مبتنی بر مرورگر)، مسائل انطباق با حریم خصوصی را نیز برطرف میکند؛ زیرا دادههای حساس هرگز شبکه محلی را ترک نمیکنند.

FunctionGemma تحت شرایط استفاده اختصاصی Gemma گوگل منتشر شده است که یک تمایز حیاتی برای توسعهدهندگان سازمانی و تجاری از مجوزهای استاندارد منبع باز مانند MIT یا Apache 2.0 ایجاد میکند. در حالی که گوگل Gemma را به عنوان یک “مدل باز” توصیف میکند، آن به معنای دقیق تعریف ابتکار منبع باز (OSI)، “منبع باز” نیست. این مجوز، استفاده تجاری رایگان، توزیع مجدد و اصلاح را امکانپذیر میسازد، اما شامل محدودیتهای استفاده خاصی است. توسعهدهندگان از استفاده مدل برای فعالیتهای محدود مانند تولید سخنان نفرتانگیز یا بدافزار منع شدهاند و گوگل حق بهروزرسانی این شرایط را برای خود محفوظ میدارد. این مجوز برای اکثریت قریب به اتفاق استارتآپها و توسعهدهندگان برای ساخت محصولات تجاری به اندازه کافی آزادانه است، اما تیمهایی که فناوریهای با کاربرد دوگانه را میسازند یا به آزادی کپیلفت سختگیرانه نیاز دارند، باید بندهای مربوط به “استفاده مضر” و انتساب را بررسی کنند.